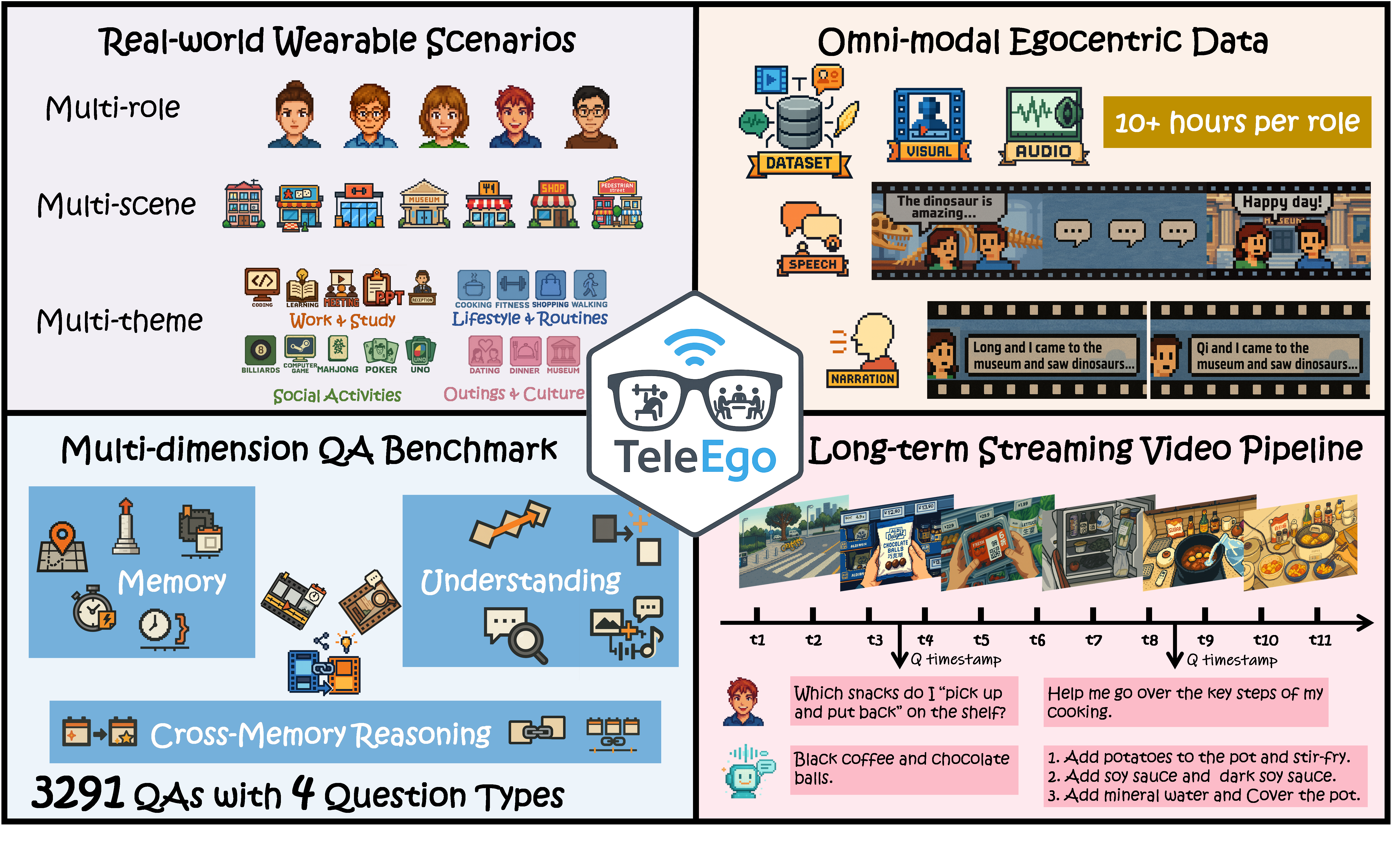

TeleEgo|流式全模态第一人称评测基准

背景与动机 第一人称AI助手指的是能够通过可穿戴设备(如智能眼镜、头戴相机)从用户的第一人称视角持续观察世界,理解用户正在做什么、看到什么、与谁交流,并在需要时提供智能帮助的AI系统。与传统的语音助手或聊天机器人不同,第一人称AI助手需要“看到”用户眼前的场景、“听到”周围的对话、“记住”过去发生的事情,并在恰当的时机主动或被动地给出建议。要真正实用,这些助手必须同时具备三项紧密整合的核心能力:

记忆能力,能够保留并回忆不断增长的过去信息流;

流式决策能力,能够在连续的音视频输入中及时做出判断;

多模态理解能力,能够以统一的方式解释摄像头看到的内容、麦克风听到的声音以及用户通过语言表达的意图。

现有benchmark在评估第一人称AI助手的这些能力时存在三大缺陷:

评估模式割裂,不能同时测记忆和实时性能:部分benchmark仅测试离线长期记忆(如X-LeBench),部分仅测试短窗口流式理解(如StreamingBench、VStream-QA);

缺乏真实第一人称流式场景:大多数数据集使用第三人称或静态视频(如OVBench、StreamingBench、OVO-B ...